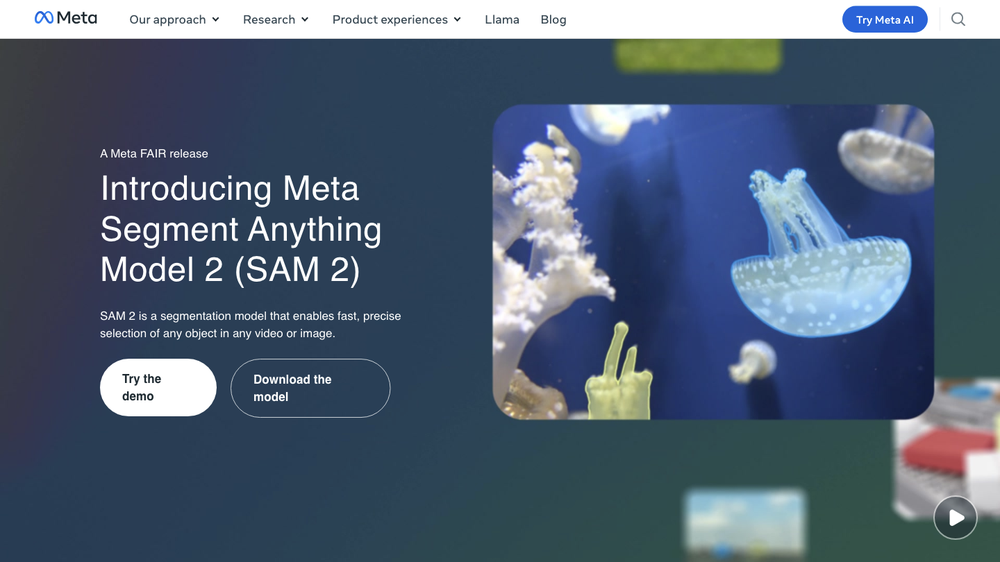

O que é o Modelo de Segmentação de Qualquer Coisa da Meta 2 (SAM 2)?

O Modelo de Segmentação de Qualquer Coisa da Meta 2 (SAM 2) é um modelo de segmentação que permite a seleção rápida e precisa de qualquer objeto em qualquer vídeo ou imagem.

Principais Características do SAM 2

Segmentar qualquer objeto, agora em qualquer vídeo ou imagem

O SAM 2 é o primeiro modelo unificado para segmentar objetos em imagens e vídeos. Você pode usar um clique, uma caixa ou uma máscara como entrada para selecionar um objeto em qualquer imagem ou frame de vídeo.

Segmentação robusta, mesmo em vídeos desconhecidos

O SAM 2 é capaz de forte desempenho zero-shot para objetos, imagens e vídeos não vistos anteriormente durante o treinamento do modelo, permitindo seu uso em uma ampla gama de aplicações do mundo real.

Interatividade em tempo real e resultados

O SAM 2 é projetado para processamento de vídeo eficiente com inferência em streaming para permitir aplicações interativas em tempo real.

Desempenho de ponta para segmentação de objetos

O SAM 2 supera os melhores modelos do campo para segmentação de objetos em vídeos e imagens.

Como Usar o SAM 2

Rastrear um objeto em qualquer vídeo interativamente

Tente o demo e rastreie um objeto em qualquer vídeo interativamente com tão pouco quanto um único clique em um frame, e crie efeitos divertidos.

A Próxima Geração do Modelo de Segmentação de Qualquer Coisa da Meta

O SAM 2 traz capacidades de segmentação de vídeo e imagem de ponta para um único modelo, preservando um design simples e velocidade de inferência rápida.

Arquitetura do Modelo

O modelo SAM 2 estende a capacidade de prompt do SAM para o domínio de vídeo adicionando um módulo de memória por sessão que captura informações sobre o objeto alvo no vídeo.

O Conjunto de Dados de Segmentação de Vídeo

Um grande e diversificado conjunto de dados de segmentação de vídeo, o SAM 2 foi treinado em um grande e diversificado conjunto de vídeos e máscaras de objeto (máscaras de objeto ao longo do tempo), criado aplicando o SAM 2 interativamente em um modelo de loop de dados.

Inovação Aberta

Para permitir que a comunidade de pesquisa construa sobre esse trabalho, estamos liberando publicamente um modelo Segment Anything 2 pré-treinado, junto com o conjunto de dados SA-V, um demo e código.

Aplicativos Potenciais do Modelo

O SAM 2 pode ser usado por si só ou como parte de um sistema maior com outros modelos em trabalhos futuros para habilitar experiências novas.

Dicas Úteis

- O SAM 2 pode ser estendido para aceitar outros tipos de prompts de entrada, como habilitar maneiras criativas de interagir com objetos em tempo real ou vídeo ao vivo no futuro.

- As saídas de segmentação de objeto de vídeo do SAM 2 podem ser usadas como entrada para outros sistemas de IA, como modelos de geração de vídeo modernos, para habilitar capacidades de edição precisas.

Perguntas Frequentes

- Como o SAM 2 funciona? O SAM 2 é um modelo de segmentação que permite a seleção rápida e precisa de qualquer objeto em qualquer vídeo ou imagem.

- Quais são as principais características do SAM 2? O SAM 2 tem várias características principais, incluindo segmentar qualquer objeto em qualquer vídeo ou imagem, segmentação robusta, interatividade em tempo real e resultados, e desempenho de ponta para segmentação de objetos.

- Como posso usar o SAM 2? Você pode tentar o demo e rastrear um objeto em qualquer vídeo interativamente com tão pouco quanto um único clique em um frame, e criar efeitos divertidos.