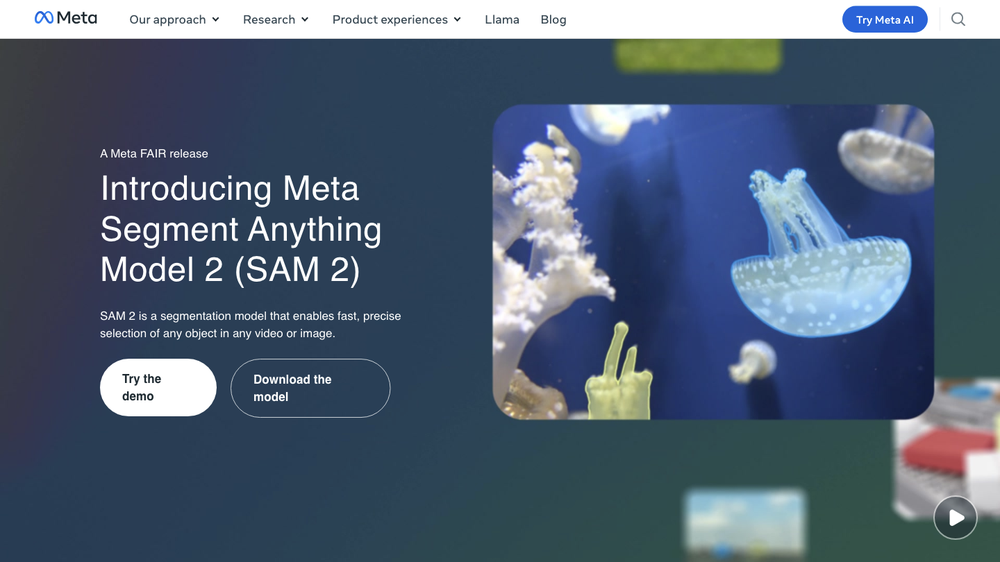

Qu'est-ce que Meta Segment Anything Model 2 (SAM 2) ?

Meta Segment Anything Model 2 (SAM 2) est un modèle de segmentation qui permet une sélection rapide et précise de n'importe quel objet dans n'importe quelle vidéo ou image.

Caractéristiques clés de SAM 2

Segmenter n'importe quel objet, maintenant dans n'importe quelle vidéo ou image

SAM 2 est le premier modèle unifié pour segmenter des objets à travers les images et les vidéos. Vous pouvez utiliser un clic, une boîte ou un masque comme entrée pour sélectionner un objet sur n'importe quelle image ou frame de vidéo.

Segmentation robuste, même dans des vidéos inconnues

SAM 2 est capable de performances zero-shot solides pour les objets, les images et les vidéos non vus précédemment pendant la formation du modèle, permettant son utilisation dans un large éventail d'applications du monde réel.

Interactivité et résultats en temps réel

SAM 2 est conçu pour un traitement vidéo efficace avec une inférence en streaming pour permettre des applications interactives en temps réel.

Performance de pointe pour la segmentation d'objets

SAM 2 surpasse les meilleurs modèles du domaine pour la segmentation d'objets dans les vidéos et les images.

Comment utiliser SAM 2

Suivre un objet à travers n'importe quelle vidéo de manière interactive

Essayez la démo et suivez un objet à travers n'importe quelle vidéo de manière interactive avec au moins un seul clic sur un frame, et créez des effets amusants.

La prochaine génération de Meta Segment Anything

SAM 2 apporte des capacités de segmentation vidéo et d'image de pointe dans un seul modèle, tout en préservant une conception simple et une vitesse d'inférence rapide.

Architecture du modèle

Le modèle SAM 2 étend la capacité de promptage de SAM au domaine vidéo en ajoutant un module de mémoire par session qui capture l'information sur l'objet cible dans la vidéo.

Le jeu de données de segmentation vidéo Segment Anything

Un grand et divers jeu de données de segmentation vidéo, SAM 2 a été entraîné sur un grand et divers ensemble de vidéos et de masques (masques d'objets au fil du temps), créés en appliquant SAM 2 de manière interactive dans un modèle de données en boucle.

Innovation ouverte

Pour permettre à la communauté de recherche de s'appuyer sur ce travail, nous publions publiquement un modèle Segment Anything 2 pré-entraîné, ainsi que le jeu de données SA-V, une démo et du code.

Applications potentielles du modèle

SAM 2 peut être utilisé seul ou comme partie d'un système plus large avec d'autres modèles dans des travaux futurs pour permettre des expériences nouvelles.

Conseils utiles

- SAM 2 peut être étendu pour prendre en charge d'autres types de prompts d'entrée, tels que dans le futur, permettant des façons créatives d'interagir avec des objets en temps réel ou en direct vidéo.

- Les sorties de segmentation d'objets vidéo de SAM 2 pourraient être utilisées comme entrée pour d'autres systèmes d'IA, tels que les modèles de génération de vidéos modernes, pour permettre des capacités d'édition précises.

Foire aux questions

- Comment SAM 2 fonctionne-t-il ? SAM 2 est un modèle de segmentation qui permet une sélection rapide et précise de n'importe quel objet dans n'importe quelle vidéo ou image.

- Quels sont les caractéristiques clés de SAM 2 ? SAM 2 a plusieurs caractéristiques clés, notamment la segmentation de n'importe quel objet dans n'importe quelle vidéo ou image, la segmentation robuste, l'interactivité et les résultats en temps réel, et la performance de pointe pour la segmentation d'objets.

- Comment puis-je utiliser SAM 2 ? Vous pouvez essayer la démo et suivre un objet à travers n'importe quelle vidéo de manière interactive avec au moins un seul clic sur un frame, et créer des effets amusants.