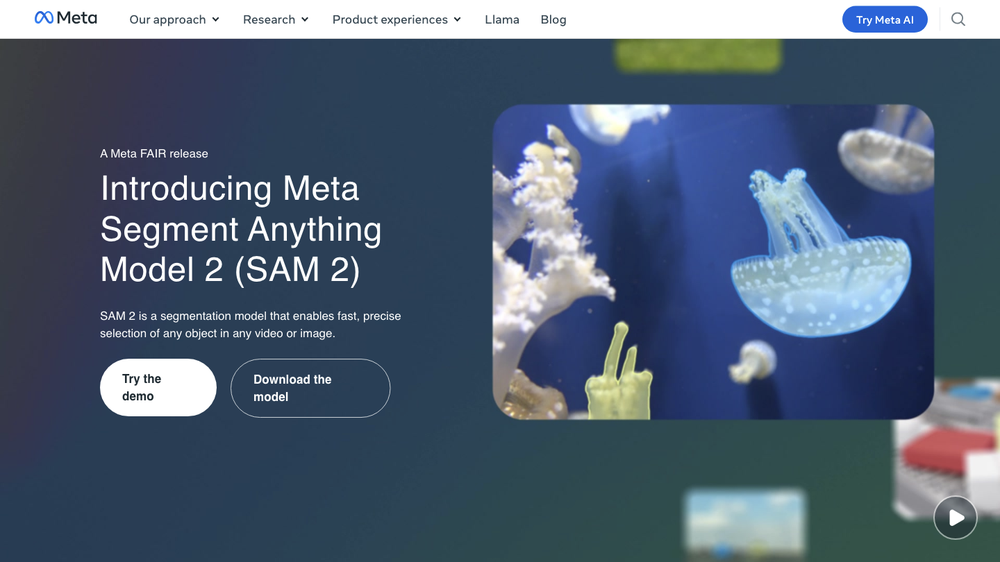

¿Qué es el Modelo de Segmentación de Cualquier cosa de Meta 2 (SAM 2)?

El Modelo de Segmentación de Cualquier cosa de Meta 2 (SAM 2) es un modelo de segmentación que permite la selección rápida y precisa de cualquier objeto en cualquier video o imagen.

Características clave de SAM 2

Segmentar cualquier objeto, ahora en cualquier video o imagen

SAM 2 es el primer modelo unificado para segmentar objetos en imágenes y videos. Puedes utilizar un clic, una caja o una máscara como entrada para seleccionar un objeto en cualquier imagen o frame de video.

Segmentación robusta, incluso en videos desconocidos

SAM 2 es capaz de un rendimiento cero-shot fuerte para objetos, imágenes y videos no vistos previamente durante el entrenamiento del modelo, lo que permite su uso en una amplia gama de aplicaciones del mundo real.

Interactividad y resultados en tiempo real

SAM 2 está diseñado para el procesamiento de video eficiente con inferencia en streaming para habilitar aplicaciones interactivas en tiempo real.

Rendimiento de vanguardia para la segmentación de objetos

SAM 2 supera a los mejores modelos en el campo de la segmentación de objetos en videos y imágenes.

Cómo utilizar SAM 2

Rastrear un objeto a lo largo de cualquier video de manera interactiva

Prueba la demo y rastrea un objeto a lo largo de cualquier video de manera interactiva con tan solo un clic en un frame, y crea efectos divertidos.

La próxima generación de Meta Segment Anything

SAM 2 lleva las capacidades de segmentación de video y imagen de vanguardia a un solo modelo, mientras preserva un diseño simple y una velocidad de inferencia rápida.

Arquitectura del modelo

El modelo SAM 2 amplía la capacidad de promptable de SAM al dominio de video agregando un módulo de memoria por sesión que captura información sobre el objeto objetivo en el video.

El conjunto de datos de Segment Anything Video

Un gran y diverso conjunto de datos de segmentación de video, SAM 2 se entrenó en un gran y diverso conjunto de videos y masklets (máscaras de objetos en el tiempo), creado aplicando SAM 2 de manera interactiva en un bucle de datos-engine.

Innovación abierta

Para permitir que la comunidad de investigación construya sobre este trabajo, estamos lanzando públicamente un modelo Segment Anything 2 preentrenado, junto con el conjunto de datos SA-V, una demo y código.

Posibles aplicaciones del modelo

SAM 2 puede utilizarse por sí solo o como parte de un sistema más grande con otros modelos en trabajos futuros para habilitar experiencias novedosas.

Consejos útiles

- SAM 2 se puede ampliar para tomar otros tipos de entradas de prompts, como habilitar formas creativas de interactuar con objetos en tiempo real o video en vivo en el futuro.

- Las salidas de segmentación de objetos de video de SAM 2 podrían utilizarse como entrada para otros sistemas de IA, como modelos de generación de video modernos, para habilitar capacidades de edición precisas.

Preguntas frecuentes

- ¿Cómo funciona SAM 2? SAM 2 es un modelo de segmentación que permite la selección rápida y precisa de cualquier objeto en cualquier video o imagen.

- ¿Cuáles son las características clave de SAM 2? SAM 2 tiene varias características clave, incluyendo la segmentación de cualquier objeto en cualquier video o imagen, segmentación robusta, interactividad y resultados en tiempo real, y rendimiento de vanguardia para la segmentación de objetos.

- ¿Cómo puedo utilizar SAM 2? Puedes probar la demo y rastrear un objeto a lo largo de cualquier video de manera interactiva con tan solo un clic en un frame, y crear efectos divertidos.