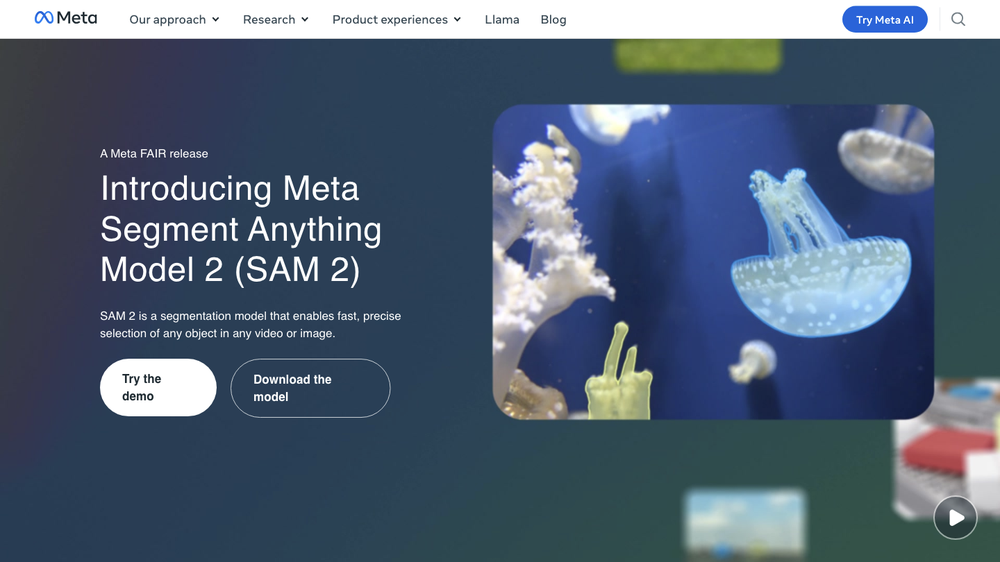

Was ist Meta Segment Anything Model 2 (SAM 2)?

Meta Segment Anything Model 2 (SAM 2) ist ein Segmentierungsmodell, das eine schnelle, genaue Auswahl von beliebigen Objekten in beliebigen Videos oder Bildern ermöglicht.

Hauptmerkmale von SAM 2

Segmentiere jedes Objekt, jetzt in jedem Video oder Bild

SAM 2 ist das erste einheitliche Modell für die Segmentierung von Objekten über Bilder und Videos hinweg. Sie können einen Klick, ein Feld oder eine Maske als Eingabe verwenden, um ein Objekt auf einem beliebigen Bild oder Videoframe auszuwählen.

Robuste Segmentierung, sogar in unbekannten Videos

SAM 2 ist in der Lage, starke Zero-Shot-Leistungen für Objekte, Bilder und Videos zu erbringen, die während des Modelltrainings nicht gesehen wurden, was die Verwendung in einer Vielzahl von realen Anwendungen ermöglicht.

Echtzeit-Interaktivität und Ergebnisse

SAM 2 ist für effiziente Videoverarbeitung mit Streaming-Inferenz konzipiert, um echtzeitnahe, interaktive Anwendungen zu ermöglichen.

Spitzenleistung für Objektsegmentierung

SAM 2 übertrifft die besten Modelle im Feld für die Objektsegmentierung in Videos und Bildern.

Wie verwende ich SAM 2

Verfolge ein Objekt interaktiv über jedes Video

Probieren Sie den Demo und verfolgen Sie ein Objekt interaktiv über jedes Video mit nur einem Klick auf einem Frame und erstellen Sie unterhaltsame Effekte.

Die nächste Generation von Meta Segment Anything

SAM 2 bringt Spitzenleistungen für die Videosegmentierung und Bildsegmentierung in ein einziges Modell, während es ein einfaches Design und eine schnelle Inferenzgeschwindigkeit beibehält.

Modellarchitektur

Das SAM 2-Modell erweitert die promptable Fähigkeit von SAM auf den Videobereich, indem es ein pro Sitzungsspeichermodul hinzufügt, das Informationen über das Zielobjekt im Video aufzeichnet.

Das Segment Anything Video-Dataset

Ein großes und vielfältiges Video-Segmentierungs-Dataset, SAM 2 wurde auf einem großen und vielfältigen Satz von Videos und Masklets (Objektmasken über die Zeit) trainiert, die durch die Anwendung von SAM 2 interaktiv in einem Modell-in-the-Loop-Daten-Engine erstellt wurden.

Offene Innovation

Um die Forschungsgemeinschaft zu ermöglichen, auf dieser Arbeit aufzubauen, veröffentlichen wir ein vortrainiertes Segment Anything 2-Modell, zusammen mit dem SA-V-Dataset, einem Demo und Code.

Potenzielle Modellanwendungen

SAM 2 kann selbstständig oder als Teil eines größeren Systems mit anderen Modellen in zukünftigen Arbeiten verwendet werden, um neue Erfahrungen zu ermöglichen.

Hilfreiche Tipps

- SAM 2 kann auf andere Arten von Eingabe-Prompts wie in Zukunft erweitert werden, um kreative Wege der Interaktion mit Objekten in Echtzeit oder Live-Video zu ermöglichen.

- Die Video-Objekt-Segmentierungs-Ausgaben von SAM 2 können als Eingabe für andere KI-Systeme wie moderne Videogenerierungsmodelle verwendet werden, um genaue Bearbeitungsfähigkeiten zu ermöglichen.

Häufig gestellte Fragen

- Wie funktioniert SAM 2? SAM 2 ist ein Segmentierungsmodell, das eine schnelle, genaue Auswahl von beliebigen Objekten in beliebigen Videos oder Bildern ermöglicht.

- Was sind die Hauptmerkmale von SAM 2? SAM 2 hat mehrere Hauptmerkmale, darunter die Segmentierung von beliebigen Objekten in beliebigen Videos oder Bildern, robuste Segmentierung, Echtzeit-Interaktivität und Ergebnisse und Spitzenleistung für die Objektsegmentierung.

- Wie kann ich SAM 2 verwenden? Sie können den Demo ausprobieren und ein Objekt interaktiv über jedes Video mit nur einem Klick auf einem Frame verfolgen und unterhaltsame Effekte erstellen.